Новая нейросеть создает видео, которое невозможно отличить от реальности

Новая нейросеть создает видео, которое невозможно отличить от реальности

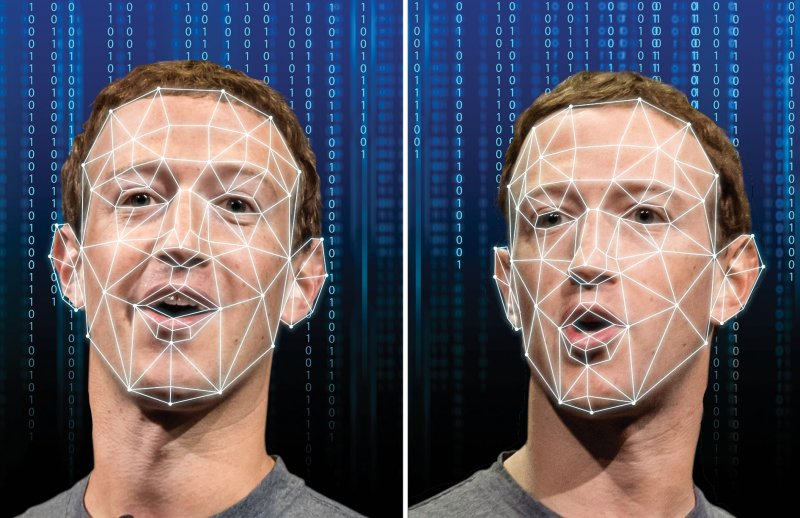

Open AI разработала новую нейросеть, которая умеет генерировать невероятно реалистичные видеоролики практически неотличимые от реальности. Эксперты опасаются, что подобные изображения могут быть использованы недобросовестными манипуляторами в политических целях.

В апреле нью-йоркский стартап Runway AI представил технологию, которая позволяет людям создавать видеоролики по запросу — например, о корове на празднике или собаке со смартфоном. Несмотря на размытость, прерывистость и помехи, четырехсекундные видео свидетельствуют о том, что в ближайшие месяцы и годы технологии искусственного интеллекта будут развиваться в этом направлении.

И вот, спустя всего 10 месяцев стартап OpenAI из Сан-Франциско представил аналогичную систему создания видеороликов, которые выглядят так, будто они взяты из голливудского фильма. На презентации показали созданные в считанные минуты короткие видео о шерстистых мамонтах, бегущих рысью по заснеженному лугу; пушистом монстрике, пристально смотрящем на тающую свечу; и с пролетом камеры над улицами Токио.

Компания OpenAI, создавшая чат-бот ChatGPT и генератор неподвижных изображений DALL-E, стремится улучшить этот вид генерации мгновенных видео наряду со стартапами и IT- гигантами, в том числе Google и Meta. Технология может ускорить работу опытных кинематографистов, полностью заменив непрофессиональных специалистов по компьютерной графике. Также она может стать быстрым и недорогим способом генерирования онлайн-дезинформации, что еще больше затруднит понимание разницы между реальным и нереальным на просторах сети.

"Я в абсолютном ужасе от осознания того, какую роль подобные вещи будут играть на выборах с острой конкуренцией", — говорит профессор Вашингтонского университета Орен Эциони, основатель некоммерческой организации True Media, в чьи функции входит выявление дезинформации в ходе политических кампаний.

OpenAI называет новую систему Sora, что в переводе с японского означает "небо". Ее создатели, в число которых входят исследователи Тим Брукс и Билл Пиблз, выбрала это название как символ "безграничного творческого потенциала". В одном из интервью они отметили, что для широкой публики Sora пока не доступна ввиду продолжающегося тестирования на предмет опасностей системы. Компания делится технологией пока лишь с небольшой группой ученых и независимых исследователей, которые будут "тестировать ее на предмет угроз извне". "Цель здесь состоит в том, чтобы дать предварительный обзор на события ближайшего будущего, чтобы люди могли увидеть возможности этой технологии, а мы — получить обратную связь", — сказал доктор Брукс.

OpenAI маркирует созданные системой видео водяными знаками, идентифицирующими их как сгенерированные ИИ. Вместе с тем в компании признают, что их можно удалить или сделать максимально незаметными. Данная система является примером генеративного ИИ, способного мгновенно создавать тексты, изображения и звуки. Подобно другим аналогичным технологиям система OpenAI учится посредством анализа цифровых данных — в данном случае видео и титрах к ним.

OpenAI отказалась вдаваться в подробности о количестве и источнике роликов, на которых училась система, отметив лишь, что в подборке были как общедоступные, так и лицензированные правообладателями видео. Компания не особо распространяется о данных, используемых для обучения ее технологиям, ввиду желания сохранить преимущество перед конкурентами — и на нее неоднократно подавали в суд за использование материалов, защищенных авторским правом.

Так, в декабре газета New York Times подала в суд на OpenAI и ее партнера Microsoft, заявив о нарушении авторских прав на новостной контент, связанный с ИИ-системами.

Sora создает видеоролики по запросу с коротким описанием, к примеру "искусно смоделированный из бумаги коралловый риф с изобилием разноцветных рыбок и прочих морских обитателей". Видеоролики хоть и впечатляют, но не всегда идеально выполнены или содержат странные / нелогичные изображения. Недавно, например, система сгенерировала видео, на котором кто-то ест печенье, которое при этом не становится меньше.

DALLE, Midjourney и другие генераторы неподвижных изображений настолько быстро совершенствуются, что за несколько лет научились создавать изображения, практически не отличимые от фотографий. Это усложнило выявление дезинформации в Интернете, а многие специалисты по компьютерной графике жалуются на трудности с поиском работы.

"В 2022 году мы все смеялись над новоявленным Midjourney и рассуждали о том, как это мило, — говорит кинохудожник из Мичигана Рид Саутен. — А сейчас народ теряет из-за него работу".

The New York Times, США

В Николаеве началась сессия горсовета: трансляция

В Николаеве началась сессия горсовета: трансляция РФ хочет сорвать Саммит мира, — Зеленский (видео)

РФ хочет сорвать Саммит мира, — Зеленский (видео) На поврежденном участке водопровода в Николаеве заканчиваются ремонтные работы: сегодня будет вода

На поврежденном участке водопровода в Николаеве заканчиваются ремонтные работы: сегодня будет вода В Николаеве горела многоэтажка: погиб человек (видео)

В Николаеве горела многоэтажка: погиб человек (видео) По Украине и в Европу - с комфортом: как работает один из лучших автовокзалов Николаева

По Украине и в Европу - с комфортом: как работает один из лучших автовокзалов Николаева Николаевский боксер Деревянченко победил американца Александера (видео)

Николаевский боксер Деревянченко победил американца Александера (видео) В Николаевской области одну из улиц назвали в честь погибшего на фронте ветерана МВД

В Николаевской области одну из улиц назвали в честь погибшего на фронте ветерана МВД В Николаеве Skoda врезалась в Ford и загорелась - двое пострадавших

В Николаеве Skoda врезалась в Ford и загорелась - двое пострадавших В Николаеве снова ремонт на Варваровском мосту: огромные пробки (видео)

В Николаеве снова ремонт на Варваровском мосту: огромные пробки (видео)